Esencia Del Patron

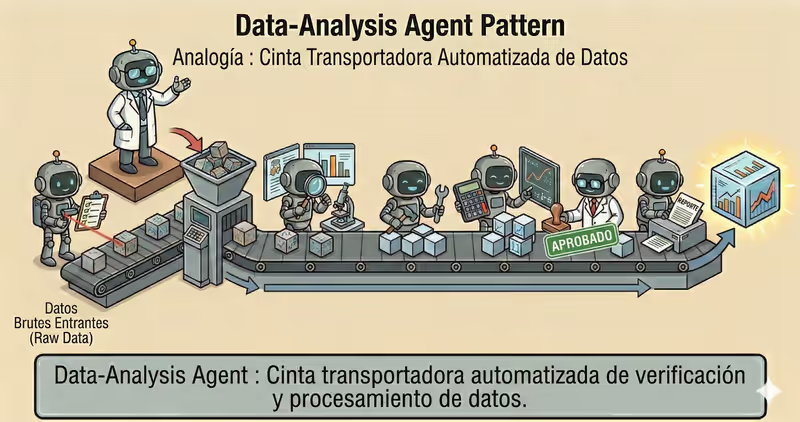

Data-Analysis Agent es un patron donde el agente trabaja con datos tabulares o series temporales mediante un pipeline analitico controlado: policy check, ingest, profile, transform, analyze, validate, report.

Cuando usarlo: cuando necesitas calcular y verificar metricas con datos reales, no describirlas con palabras generales.

A diferencia de "solo responder", el agente ejecuta analitica secuencial:

Ingest + profile: lee datos y verifica calidadTransform: limpia anomalias y faltantes segun reglasAnalyze: calcula metricas, KPI y agregadosValidate: verifica consistencia de resultadosReport: arma conclusiones y artefactos para auditoria

Problema

Imagina que preguntas:

"Cuanto ganamos la semana pasada?"

Recibes un numero, pero no entiendes que se hizo con los datos antes del calculo.

Quedan preguntas criticas:

- si se incluyeron devoluciones

- si se eliminaron duplicados

- como se trataron los faltantes

- si partes de datos desaparecieron durante la "limpieza"

Analitica sin proceso fijo entrega numeros dificiles de explicar, verificar y reproducir.

Por eso distintas personas pueden calcular el mismo dataset de manera diferente.

Ese es el problema central: sin pipeline transparente, el resultado del analisis se vuelve impredecible y no auditable.

Solucion

Data-Analysis Agent opera mediante un pipeline analitico fijo.

Analogia: es como un analisis de laboratorio. Primero se toma una muestra y se revisa su calidad, luego se calculan indicadores. Sin esa secuencia no se puede confiar en los numeros.

Principio clave: el valor no esta solo en el numero, sino en que cada paso del analisis puede explicarse y reproducirse.

El agente no puede "calcular directo" - debe pasar por pasos:

- Policy check: verificar acceso a la fuente

- Ingest: cargar datos

- Profile: revisar estructura y calidad

- Transform: limpiar por reglas

- Analyze: calcular metricas

- Validate: verificar resultado

Y debe registrar:

- fuente de datos

- reglas de limpieza

- verificaciones ejecutadas

- limitaciones de datos

Esto permite mostrar, por ejemplo:

- que filas fueron eliminadas

- como se trataron faltantes

- que anomalias se detectaron

- que invariantes pasaron

Funciona bien si:

- el paso de ingest no puede saltarse

- las reglas de limpieza estan fijadas

- el paso de validacion es obligatorio

- la capa de ejecucion no permite saltar pasos del pipeline

Analitica confiable es un pipeline que el agente no puede saltarse tecnicamente.

Como Funciona

Este patron suele usar Code-Execution Agent para ejecutar calculos en sandbox.

Diferencia clave: aqui el foco no es ejecutar codigo como tal, sino el ciclo analitico completo con controles de calidad.

Flujo completo: Policy Check → Ingest → Profile → Transform → Analyze → Validate → Report

Policy Check

Antes de procesar, el sistema verifica fuente, rol de acceso y sensibilidad de datos (PII).

Ingest

Los datos se cargan registrando fuente, periodo y version.

Profile

El agente revisa schema, faltantes, duplicados y outliers.

Transform

Limpieza y normalizacion: tipos de campo, filtros, tratamiento de missing values.

Analyze

Calculo de KPI, agregados y comparaciones.

Validate

El sistema verifica invariantes: rangos de metricas, ausencia de valores negativos, consistencia de agregados.

Report

Se forma el resultado: tablas, graficos, conclusiones clave y evidence.

En Codigo Se Ve Asi

decision = policy_engine.evaluate_source(source, user_role=user_role)

if decision.type != "allow":

return stop_with_reason("source_policy_denied")

df = load_data(source)

profile = profile_data(df)

if profile.schema_mismatch:

return stop_with_reason("schema_mismatch")

df_clean = clean_data(df, rules=cleaning_rules)

metrics = compute_metrics(df_clean)

checks = validate_metrics(metrics, rules=[

"no_negative_revenue",

"conversion_between_0_1",

])

if not checks.ok:

return escalate_or_fallback(checks.errors)

report = build_report(metrics, checks, profile)

return report

El resultado analitico debe incluir no solo numeros, sino tambien evidence: que checks pasaron y que limitaciones tenia el dato.

Como Se Ve En Ejecucion

Goal: preparar resumen semanal de ventas

Ingest:

- sales.csv de los ultimos 7 dias

Profile:

- 2% faltantes en channel

- 1 outlier en revenue

Transform:

- completar channel = "unknown"

- eliminar duplicado id=8472

Analyze:

- revenue: 142,300

- conversion: 3.84%

- top channel: paid_search

Validate:

- todas las invariantes pasaron

Report:

- tabla KPI + conclusiones cortas

Ejemplo completo de agente Data-Analysis

Cuando Encaja - Y Cuando No

Encaja

| Situacion | Por Que Data-Analysis Encaja | |

|---|---|---|

| ✅ | Analitica regular sobre datasets | El patron funciona bien para procesamiento sistematico y repetible de datos. |

| ✅ | Metricas reproducibles | El pipeline asegura estabilidad de resultados entre ejecuciones. |

| ✅ | Checks de calidad obligatorios antes de conclusiones | Validaciones e invariantes reducen riesgo de interpretaciones incorrectas. |

| ✅ | Resultado apto para auditoria | Resultado y pasos de procesamiento son transparentes y verificables. |

No Encaja

| Situacion | Por Que Data-Analysis No Encaja | |

|---|---|---|

| ❌ | Volumen pequeno de datos | Analisis manual sera mas simple y mas barato. |

| ❌ | Tarea puramente textual | Sin calculos ni checks, el pipeline analitico es innecesario. |

| ❌ | No hay infraestructura de ejecucion | Sin infraestructura no se puede garantizar validacion ni reproducibilidad. |

Porque Data-Analysis Agent necesita ingenieria adicional: pipeline, checks, monitoreo y versionado de fuentes.

Diferencia Frente A Code-Execution

| Code-Execution | Data-Analysis | |

|---|---|---|

| Rol | Ejecutar codigo de forma segura | Ciclo analitico completo sobre datos |

| Foco | sandbox en entorno de ejecucion y control del run | Calidad de metricas y conclusiones analiticas |

| Output | Resultado de ejecucion de codigo | KPI, checks, conclusiones, reporte |

| Riesgo principal | Ejecucion insegura/inestable | Interpretacion incorrecta o datos sucios |

Code-Execution es mecanismo de ejecucion. Data-Analysis es proceso para obtener resultado analitico confiable.

Cuando Usar Data-Analysis (vs Otros Patrones)

Usa Data-Analysis cuando necesitas explorar datos y devolver conclusiones basadas en analisis.

Prueba rapida:

- si necesitas "explicar que esta pasando en los datos y dar conclusiones" -> Data-Analysis

- si necesitas "solo ejecutar codigo y obtener output tecnico" -> Code-Execution Agent

Comparacion con otros patrones y ejemplos

Chuleta rapida:

| Si la tarea se ve asi... | Usa |

|---|---|

| Despues de cada paso hay que decidir que hacer despues | ReAct Agent |

| Primero hay que dividir una meta grande en tareas pequenas ejecutables | Task Decomposition Agent |

| Necesitas ejecutar codigo, validar resultados e iterar de forma segura | Code Execution Agent |

| Necesitas explorar datos y devolver conclusiones basadas en analisis | Data Analysis Agent |

| Necesitas investigacion en varias fuentes con evidencia estructurada | Research Agent |

Ejemplos:

ReAct: "Encuentra causa de caida de API: revisa logs -> mira errores -> corre siguiente check segun resultado".

Task Decomposition: "Preparar lanzamiento de nuevo plan: divide en subtareas para contenido, tecnica, QA y soporte".

Code Execution: "Calcula retention de 12 meses en Python y valida formulas con datos reales".

Data Analysis: "Analiza CSV de ventas: encuentra tendencias, outliers y da conclusiones cortas".

Research: "Reune datos de 5 competidores desde varias fuentes y haz resumen comparativo".

No sabes si tu caso es principalmente de Data Analysis? Diseñar tu agente →

Como Combinar Con Otros Patrones

- Data-Analysis + Code-Execution: cuando hay que calcular o transformar datos, el agente ejecuta codigo en sandbox con limites.

- Data-Analysis + Guarded-Policy: si hay datos sensibles, las policies limitan que tablas y campos se pueden leer.

- Data-Analysis + Fallback-Recovery: si falla fuente o paso, el pipeline cambia a ruta segura de recuperacion.

Resumen

Data-Analysis Agent:

- Trabaja con datos mediante pipeline secuencial

- Agrega checks de calidad en cada etapa

- Devuelve metricas y conclusiones reproducibles

- Reduce riesgo de errores en decisiones de negocio

Ventajas Y Desventajas

Ventajas

procesa rapido grandes volumenes de datos

ayuda a encontrar tendencias y outliers

el resultado se puede verificar y repetir

util para construir reportes y graficos

Desventajas

sin datos de calidad, las conclusiones seran debiles

calculos complejos pueden ser lentos

hacen falta checks para evitar conclusiones falsas

FAQ

Q: Puede el agente analizar sin perfilar datos?

A: Puede, pero es riesgoso. Sin paso profile, es facil omitir problemas de schema y romper metricas.

Q: Para que validar metricas despues del calculo?

A: Para detectar anomalias antes de enviar resultado: revenue negativo, conversion fuera de [0,1] y otras invariantes.

Q: Data-Analysis Agent reemplaza un sistema BI?

A: No. Complementa BI: automatiza analisis puntual, limpieza y explicacion, pero no reemplaza data governance.

Que Sigue

Data-Analysis Agent trabaja con datos estructurados y metricas reproducibles.

Como construir un agente para investigacion open-world: busqueda de fuentes, lectura, extraccion de hechos y citas?