Wenn ein Agent zum ersten Mal selbstständig arbeitet, fühlt sich das wie ein Sieg an.

Du schreibst keine Anweisungen mehr, kontrollierst nicht jeden Schritt und greifst nicht nach jedem Fehler ein.

Du sagst einfach: „Mach das“ und das System arbeitet.

Es findet Daten, probiert Tools aus, ändert den Ansatz, wenn etwas nicht funktioniert. Und am Ende kommt es mit einem Ergebnis zurück.

Aber genau in diesem Moment entsteht ein neues Problem.

Denn ein Agent, der selbst handeln kann, kann auch ohne dich handeln.

Und das bedeutet, dass er:

- Geld ausgeben kann

- Daten ändern kann

- APIs aufrufen kann

- Prozesse starten kann

Ohne deine Freigabe für jeden Schritt.

Und wenn du ihm keine Grenzen setzt, arbeitet er weiter, selbst wenn er schon aufhören sollte. Manchmal bis zu dem Moment, in dem du die Rechnung öffnest und die Summe siehst.

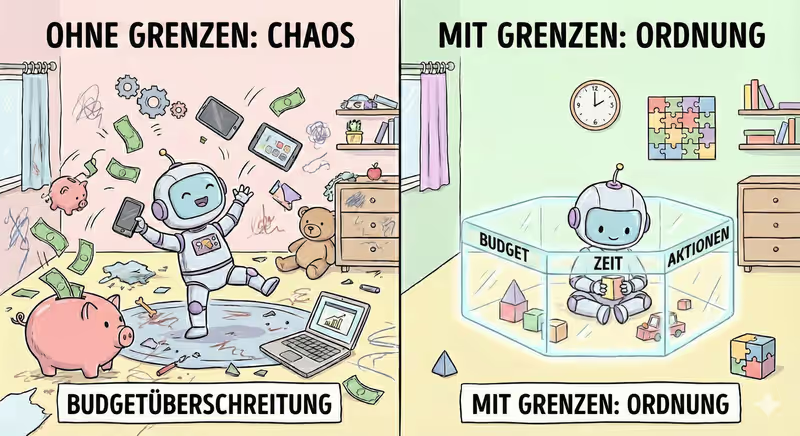

Was „Grenzen“ in der Praxis bedeuten

Wenn wir über Grenzen für einen Agenten sprechen, geht es nicht um Vertrauen.

Es geht um Begrenzungen, die festlegen, wo er handeln darf und wo er stoppen muss.

So sieht das in der Praxis aus:

1. Budget

Wie viel darf der Agent ausgeben?

Das können Kosten für APIs, Tokens oder Rechenzeit sein.

Wenn das Limit erreicht ist, stoppt die Arbeit.

2. Zeit

Wie viel Zeit darf der Agent für eine Aufgabe aufwenden?

Wenn er bis zur Deadline nicht fertig ist, kommt er mit dem zurück, was er hat.

3. Erlaubte Aktionen

Was darf der Agent überhaupt tun?

- Daten lesen?

- E-Mails senden?

- Prozesse starten?

- Dateien löschen?

Nicht alles, was er kann, darf er auch.

4. Tool-Zugriff

Auf welche Services darf er zugreifen?

Welche APIs darf er aufrufen?

Welche Datenbanken darf er lesen?

Weniger Zugriff bedeutet weniger Risiko.

5. Stoppbedingungen

Wann soll der Agent die Arbeit beenden?

Zum Beispiel:

- Wenn sich das Ergebnis nicht verbessert

- Wenn die Kosten das Limit überschritten haben

- Wenn die Daten widersprüchlich sind

| Grenze | Was sie begrenzt | Was bei Überschreitung passiert |

|---|---|---|

| 💰 Budget | Ausgaben für API oder Tokens | Der Agent stoppt |

| ⏱ Zeit | Dauer der Aufgabenausführung | Gibt ein Teilergebnis zurück |

| 🔐 Aktionen | Was der Agent tun darf | Aktion wird abgelehnt |

| 🛠 Tools | Auf welche Services er zugreifen darf | Anfrage wird blockiert |

| 🛑 Stoppbedingungen | Wann die Arbeit beendet wird | Die Schleife wird beendet |

Grenzen sind kein Hindernis für den Agenten.

Sie machen ihn zu einem sicheren Ausführer statt zu einem unkontrollierten Prozess.

Was passiert, wenn es keine Grenzen gibt

Der Agent bekommt eine Aufgabe.

Zum Beispiel: „Optimiere die Infrastrukturkosten.“

Er beginnt zu handeln.

Er findet einen Service mit hohen Kosten und senkt das Limit. Er prüft, die Kosten sinken.

Aber das Ergebnis ist noch nicht ideal.

Er sucht weiter. Er findet einen anderen Prozess, ebenfalls teuer. Er begrenzt ihn.

Er prüft, die Kosten sinken erneut.

Aber mit ihnen auch die Leistung.

Ein Teil der Requests beginnt Fehler zurückzugeben. Der Service antwortet langsamer. Nutzer beschweren sich.

Der Agent „versteht“ das nicht. Er sieht nur das Ziel: Kosten senken.

Und er handelt weiter.

Noch ein Limit. Noch eine Optimierung. Noch ein Schritt in die „richtige“ Richtung.

Bis er die Kosten am Ende so weit senkt, dass das System nicht mehr funktioniert.

Nicht wegen eines Ausfalls.

Sondern wegen Sorgfalt.

Der Agent hat genau das getan, worum du gebeten hast.

Nur ohne Grenzen.

Das zentrale Verständnis

Ein KI-Agent ist nicht gefährlich, weil er Fehler macht. Und nicht, weil er „zu schlau“ ist.

Er ist gefährlich, weil er nicht von selbst aufhört.

Der Agent handelt, bis er:

- das Ziel erreicht

- oder auf eine Begrenzung trifft

Und wenn es keine Begrenzungen gibt, läuft er weiter, selbst wenn er dem System schadet.

Denn für ihn ist das kein Schaden.

Es ist einfach ein weiterer Schritt zum Ergebnis.

Deshalb sind Grenzen keine Einschränkung für den Agenten.

Sie sind Schutz für dich.

Kurz

Ein KI-Agent kann selbstständig handeln.

Aber ohne gesetzte Grenzen bewegt er sich weiter zum Ziel, auch wenn das dem System schadet.

FAQ

Q: Warum braucht ein KI-Agent Grenzen?

A: Um seine Aktionen und Ausgaben bei der Aufgabenausführung zu begrenzen und die Arbeit zu stoppen, wenn sie dem System zu schaden beginnt.

Q: Was kann ohne gesetzte Grenzen passieren?

A: Der Agent kann weiter auf das Ziel hinarbeiten, auch wenn das zu Fehlern, geringerer Leistung oder unnötigen Kosten führt.

Q: Wann sollte der Agent stoppen?

A: Wenn das Ergebnis erreicht ist oder wenn eine Stoppbedingung erfüllt ist, zum Beispiel ein überschrittenes Budget oder eine verpasste Deadline.

Was als Nächstes

Jetzt weißt du, warum Grenzen kritisch sind.

Aber um sie richtig zu setzen, musst du verstehen, woraus ein KI-Agent besteht.

Denn Grenzen sind nicht nur Zahlen in Einstellungen. Sie sind Begrenzungen für konkrete Teile des Systems:

- für das Ziel, das der Agent verfolgt

- für das Gedächtnis, aus dem er Kontext nimmt

- für die Tools, die er nutzen kann

- für die Schleife, die bestimmt, wie oft er versucht

Wenn du nicht verstehst, wie ein Agent innen funktioniert, kannst du ihn außen nicht kontrollieren.

Genau darum geht es im nächsten Artikel.