Quand les gens voient pour la première fois un agent travailler tout seul, ils ont presque toujours une réaction :

"Il réfléchit vraiment tout seul ?"

Vu de l'extérieur, cela paraît vraiment impressionnant. Tu ne cliques sur rien, tu ne suggères pas l'étape suivante et tu ne guides pas le processus à la main, mais le système fait quand même quelque chose.

Il essaie une option, ça ne marche pas. Il en cherche une autre. Il change d'approche. Et au final, il revient avec un résultat.

À ce moment-là, on croit facilement qu'une sorte de magie se produit à l'intérieur. Mais ici, il n'y a pas de magie. Il y a une logique assez simple.

Un agent ne "pense" pas comme un humain, il fonctionne en boucle

Quand on dit qu'un agent "pense", on décrit en réalité une impression, pas ce qui se passe vraiment.

Vu de l'extérieur, cela ressemble à de la réflexion : le système semble s'arrêter, "réfléchir" à quelque chose, puis faire un pas pertinent. Mais à l'intérieur, tout est plus simple.

Il répète simplement un processus :

Et encore.

Vu de l'extérieur, cela ressemble à un "comportement intelligent". Mais en réalité, c'est une boucle, pas une pensée.

Le même principe qu'une personne qui essaie d'ouvrir une porte fermée : d'abord tirer, puis pousser, puis chercher une clé. Pas parce qu'elle a conçu le plan parfait, mais parce qu'elle teste des options jusqu'à ce que quelque chose fonctionne.

Grâce à cette boucle, l'agent ne casse pas au premier échec. Il ne s'attend pas à ce que tout suive le plan. Pour lui, une erreur est juste un état de plus à partir duquel avancer.

Un agent peut parfois faire un plan, mais même dans ce cas, il ne l'exécute pas d'un coup.

Il continue quand même en boucle : évaluer la situation -> choisir une action -> vérifier le résultat -> et ajuster le plan si nécessaire.

Structure de la boucle : comment un agent avance

Malgré toute la "magie", la boucle d'un agent est très simple. Elle se compose de quelques étapes qui se répètent en continu.

- Comprendre la situation L'agent regarde ce qui existe maintenant : quelles données sont disponibles, ce qui a déjà été fait, ce qui a mal tourné. Ce n'est pas une analyse profonde, juste une capture d'état.

"D'accord, je suis là. Qu'est-ce que j'ai ?"

-

Choisir l'étape suivante À partir de cela, il choisit une action qui a du sens exactement à ce moment. Pas la meilleure en théorie. Pas parfaite. Juste la tentative raisonnable suivante.

-

Action Il fait ce qu'il a choisi : appelle un outil, travaille avec des données, change la situation. Aucune garantie que cela marche. C'est une tentative, pas un plan.

-

Vérifier le résultat Après l'action, l'agent regarde ce qui a changé. Plus proche de l'objectif signifie bien, on continue. Nouvelle information signifie ajuster la direction. Chemin bloqué signifie en chercher un autre.

Et encore, en boucle. Jusqu'à obtenir un résultat. Ou jusqu'à ce que l'agent atteigne une limite qu'il ne peut plus franchir.

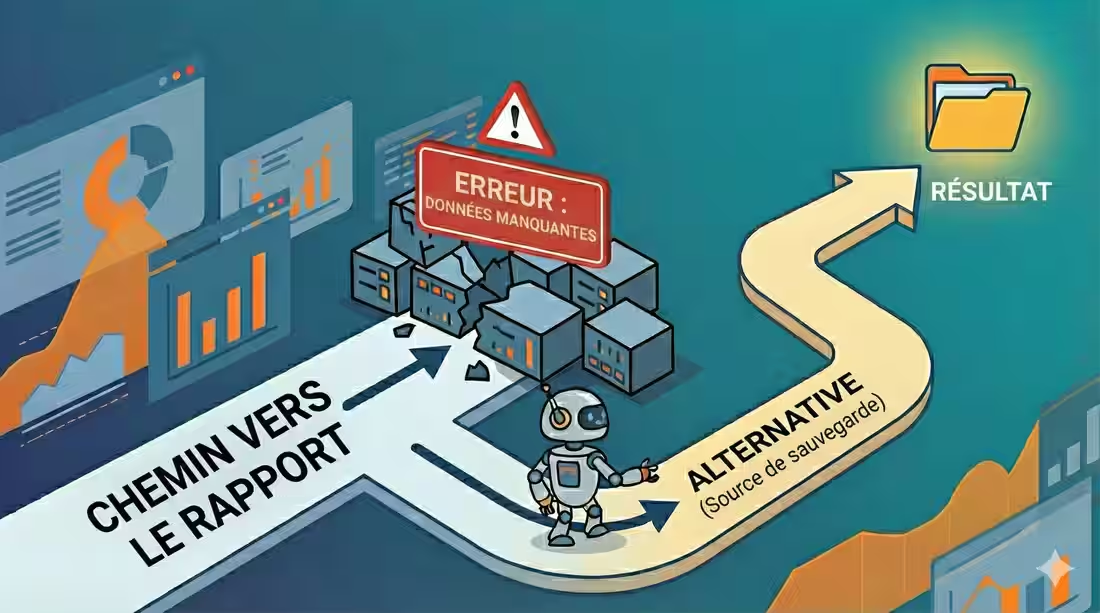

Exemple concret : comment un agent parcourt la boucle sur une tâche réelle

Imaginons une tâche simple. Tu dis à l'agent :

"Prépare un rapport de dépenses de la semaine dernière pour ce soir."

Aucune instruction. Aucune étape. Seulement le résultat. Voici ce qui se passe ensuite, étape par étape.

Boucle 1 : Comprendre la situation

L'agent commence par regarder ce qui existe. Où peuvent être les données de dépenses : dans une base, dans des fichiers, dans un service d'analytics ?

Il trouve la source principale, le système comptable, et voit un problème : une partie des données du mardi est manquante.

Ce n'est pas une erreur. C'est simplement l'état actuel.

Boucle 2 : Choisir l'étape suivante

L'agent ne s'arrête pas et n'écrit pas : "Que dois-je faire ?"

Il choisit une tentative évidente : vérifier une source de secours. Peut-être que les données sont dans les logs. Peut-être dans un autre service. Peut-être dans le cache.

Ce n'est pas une solution parfaite. C'est simplement l'étape raisonnable suivante.

Boucle 3 : Action

L'agent interroge les logs système pour récupérer les données manquantes.

Résultat : il en trouve une partie. Une autre partie, non.

Il combine ce qu'il a et voit que pour un rapport complet, il manque encore plusieurs valeurs du mardi.

Boucle 4 : Vérification et nouvelle décision

L'agent regarde l'image globale. Le rapport est presque prêt, mais il y a des trous.

Il a maintenant plusieurs options :

- essayer une autre source

- estimer les données de façon approximative

- noter qu'une partie de l'information est indisponible

Il choisit la troisième option : terminer le rapport avec une note sur les données manquantes. Cela permet d'avancer sans mentir.

Boucle 5 : Action finale

L'agent prépare le rapport : tableau des dépenses hebdomadaires, graphique de tendance, conclusion.

Dans la note, il indique : "Les données du 8 octobre (mardi) sont partiellement indisponibles en raison d'une panne du système comptable. Le rapport est basé sur les 87% d'enregistrements disponibles."

Il enregistre le fichier. Terminé.

Retour vers toi

L'agent écrit : "Le rapport est prêt. Les données de la semaine dernière ont été collectées, une partie des enregistrements du mardi était indisponible et a été documentée dans la note. Fichier en pièce jointe."

Ce qui est important ici

À aucun moment l'agent n'a :

- attendu la commande suivante

- "planté" à cause d'une erreur

- arrêté parce que quelque chose n'était pas parfait

Il a simplement parcouru la boucle encore et encore jusqu'à atteindre le meilleur résultat possible dans ces conditions.

C'est pour cela que, vu de l'extérieur, on a l'impression que l'agent "pense". Mais en réalité, il ne pense pas, il ne s'arrête pas.

En bref

Un agent IA est utile non pas parce qu'il "pense". Et non pas parce qu'il fait toujours tout correctement. Il est utile parce qu'il ne s'arrête pas quand quelque chose sort du plan. Un agent ne connaît pas le chemin idéal à l'avance. Il avance simplement vers l'objectif en vérifiant constamment ce qui a fonctionné et ce qui n'a pas fonctionné. Pour lui, une erreur n'est ni un échec ni une raison d'attendre une personne, mais un état de plus à partir duquel il peut faire l'étape suivante. C'est précisément cette persistance qui crée la sensation de "comportement intelligent". Pas de magie. Pas de conscience. Juste une boucle qui ne s'arrête pas au premier échec.

FAQ

Q : Un agent "réfléchit" vraiment avant de faire quelque chose ?

A : Non. Ce qui ressemble à de la réflexion est la répétition de la boucle : évaluer l'état -> choisir une action -> vérifier le résultat.

Q : Que se passe-t-il si l'action ne fonctionne pas ?

A : L'agent vérifie le résultat et essaie une autre option dans la boucle suivante.

Q : Quand l'agent arrête-t-il de travailler ?

A : Quand le résultat est atteint ou quand les actions suivantes n'ont plus de sens.

Et ensuite

Maintenant que tu comprends comment un agent avance en boucle et pourquoi il ne s'arrête pas à la première erreur, il est temps de passer à l'étape suivante.

Passons à la pratique : Construisons ton premier agent IA